Qwen3-VL——技术报告详解

引言: Qwen3-VL 是 Qwen 系列目前最强大的视觉语言模型,原生支持最多 256K token 的交错上下文(文本、图像、视频),在广泛的视觉语言基准上实现了领先性能。模型家族包含稠密模型(2B/4B/8B/32B)和 MoE 模型(30B-A3B/235B-A22B),在 MMMU、MathVista、DocVQA 等关键基准上超越 GPT-5 和 Gemini 2.5 Pro,同时保持了与纯文本模型相当的语言能力。

✈️ 引言

视觉语言模型(VLM)近年来取得了实质性进展,从基础视觉感知发展到跨图像和视频的高级多模态推理。VLM 的快速演进催生了丰富的下游应用场景:长上下文理解、STEM 推理、GUI 理解与交互、智能体工作流等。关键在于,这些进展不能侵蚀底层大语言模型(LLM)的语言能力——多模态模型需要在语言基准上匹配或超越其纯文本对应版本。

Qwen3-VL 基于 Qwen3 系列,实现了四大稠密模型(2B/4B/8B/32B)和两个 MoE 模型(30B-A3B / 235B-A22B),每个模型都以最高 256K token 的上下文窗口进行训练。通过优化训练语料和训练策略,在视觉语言训练过程中保留了底层 LLM 的语言能力,显著提升了整体能力。模型发布了非思考和思考两种变体,后者在复杂推理任务上展现出更强的多模态推理能力。

阅读提示: 本文为技术报告翻译,将按原文结构依次介绍模型架构、预训练策略和全面的评估结果。旗舰模型 Qwen3-VL-235B-A22B 在 STEM 推理、文档理解、视频理解等多个领域展现出 SOTA 性能。

🏗️ 模型架构

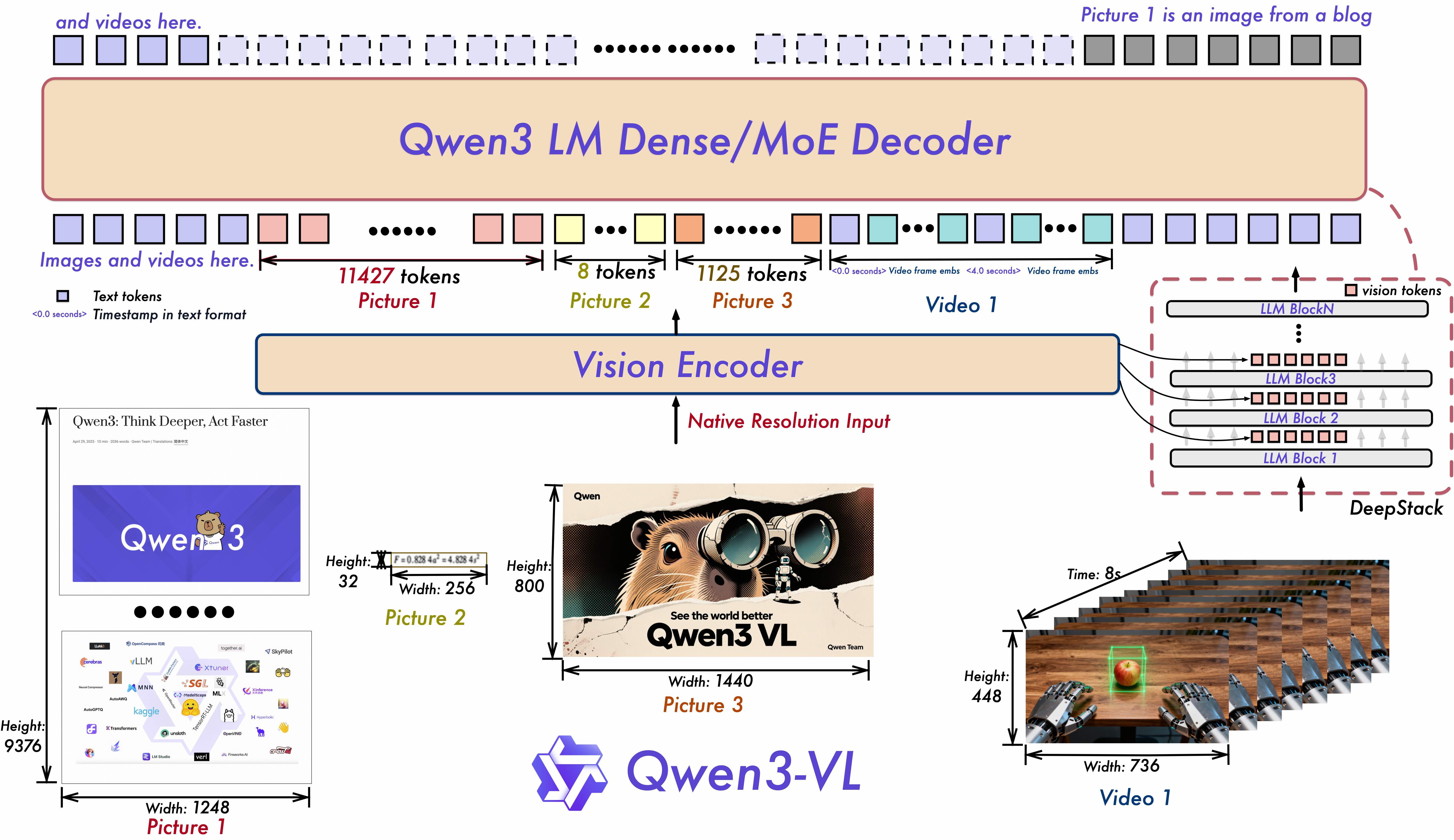

Qwen3-VL 沿用 Qwen2.5-VL 的三模块架构,包含视觉编码器、MLP 视觉语言合并器和大语言模型(LLM)。

大语言模型

Qwen3-VL 包含四个稠密变体(Qwen3-VL-2B/4B/8B/32B)和两个 MoE 变体(Qwen3-VL-30B-A3B、Qwen3-VL-235B-A22B),均基于 Qwen3 骨干构建。旗舰模型 Qwen3-VL-235B-A22B 拥有 235B 总参数,每个 token 激活 22B 参数,在广泛的多模态任务上超越了大多数 VLM,并在多数语言基准上超越了其纯文本对应版本。

视觉编码器

采用 SigLIP-2 架构作为视觉编码器,从官方预训练检查点开始,使用动态输入分辨率进行持续训练。为有效适应动态分辨率,采用 2D-RoPE 并根据输入大小插值绝对位置编码。默认使用 SigLIP2-SO-400M 变体,小规模 LLM(2B 和 4B)使用 SigLIP2-Large(300M)。

MLP 视觉语言合并器

如 Qwen2.5-VL,使用两层 MLP 将视觉编码器的

交错 MRoPE

Qwen2-VL 引入 MRoPE 对多模态输入的位置信息进行建模。原始公式将嵌入维度划分为时间(t)、水平(h)和垂直(w)子空间,每个子空间分配不同的旋转频率。这导致不平衡的频谱,后续研究表明这会降低长视频理解基准的性能。

为解决这一问题,Qwen3-VL 重新设计了频率分配,将 t、h、w 分量交错分布在嵌入维度上。这确保每个时空轴在低频和高频带上均匀表示,产生的平衡频谱缓解了原始频谱偏差,显著改善了长视频的位置建模。

DeepStack

受 DeepStack 启发,Qwen3-VL 将视觉 token 注入 LLM 的多个层。与原始 DeepStack 从多尺度视觉输入堆叠 token 不同,这里扩展到从视觉编码器(ViT)的中间层提取视觉 token。这种设计保留了丰富的视觉信息,从低级到高级表示。

具体而言,从视觉编码器的三个不同层级选择特征,然后通过专门的视觉语言合并器将这些多级特征投影为视觉 token,直接添加到 LLM 前三层的对应隐藏状态中。

为验证 DeepStack 机制的有效性,作者在内部 15B-A2B LLM 上进行消融实验,所有实验均在 200B token 上预训练:

| 方法 | AVG | AI2D | OCRBench | TVQA | InfoVQA | ChartQA | DocVQA | MMMU | MMStar |

|---|---|---|---|---|---|---|---|---|---|

| Baseline | 74.7 | 81.8 | 81.0 | 80.6 | 71.9 | 81.5 | 89.5 | 52.9 | 55.5 |

| DeepStack | 76.0 | 83.2 | 83.6 | 80.5 | 74.2 | 83.3 | 91.1 | 54.1 | 57.7 |

配备 DeepStack 的模型在各项基准上均实现整体性能提升,尤其在对细粒度视觉理解要求较高的 InfoVQA 和 DocVQA 基准上提升显著。这归功于 DeepStack 整合丰富视觉信息的能力,有效增强了细粒度视觉理解能力。

DeepStack 收益: 通过从 ViT 中间层提取特征并注入 LLM 多层,DeepStack 在 InfoVQA (+2.3) 和 DocVQA (+1.6) 等文档理解任务上提升显著。这表明多级视觉特征融合对细粒度视觉理解尤为有效。

视频时间戳

Qwen2.5-VL 使用 MRoPE 的时间同步变体赋予模型时间感知能力,但存在两个关键局限:

- 将时间位置 ID 直接绑定到绝对时间,对长视频产生过大且稀疏的时间位置 ID,降低长时序上下文理解能力

- 有效学习需要跨各种帧率进行广泛且均匀的采样,显著增加训练数据构建成本

为此,Qwen3-VL 采用基于文本 token 的时间编码策略,每个视频时间 patch 前缀一个格式化的时间戳文本字符串(如 <3.0 seconds>)。训练时生成秒和 HMS(时:分:秒)两种格式的时间戳,确保模型学会解释多样时间码表示。虽然上下文长度略有增加,但模型能更有效地感知时间信息,便于时间感知视频任务如视频定位和密集字幕。

📊 预训练

训练配方

首先基于预训练的 SigLIP-2 模型进行动态分辨率的持续训练,增强视觉编码器。整体 Qwen3-VL 模型采用三模块架构,包含视觉编码器、MLP 视觉语言合并器和 Qwen3 LLM 骨干。预训练方法系统性地分为四个阶段:

| 阶段 | 目标 | 训练参数 | Token 预算 | 序列长度 |

|---|---|---|---|---|

| S0 | 视觉语言对齐 | 合并器 | 67B | 8,192 |

| S1 | 多模态预训练 | 全部 | ~1T | 8,192 |

| S2 | 长上下文预训练 | 全部 | ~1T | 32,768 |

| S3 | 超长上下文适应 | 全部 | 100B | 262,144 |

阶段 0:视觉语言对齐。 初始阶段专注于高效弥合视觉编码器和 LLM 之间的模态差距。关键是只训练 MLP 合并器参数,视觉编码器和 LLM 骨干保持冻结。使用约 67B token 的精选数据集,包含高质量图像-标题对、视觉知识集合和 OCR 数据。序列长度为 8,192。这种对齐优先的方法在全参数训练前建立了坚实的跨模态理解基础。

阶段 1:多模态预训练。 过渡到全参数多模态预训练,解冻所有模型组件进行端到端训练。使用约 1T token 的大规模多样数据集。为保持 LLM 的强语言能力,数据混合包含视觉语言(VL)数据和纯文本数据。VL 部分包含交错图文文档、视觉定位任务、视觉问答、STEM 领域数据和少量视频数据。序列长度保持 8,192。

阶段 2:长上下文预训练。 显著扩展模型的上下文处理能力,序列长度四倍增至 32,768,所有参数继续训练。使用约 1T token,调整数据混合以支持长上下文任务。增加纯文本数据比例以加强长篇文本理解,VL 数据包含更多视频和智能体导向的指令遵循数据。这对长视频和复杂多步任务至关重要。

阶段 3:超长上下文适应。 将上下文窗口推至极限,序列长度增至 262,144。使用专门的 100B token 数据集,强调长视频和长文档理解任务。这巩固了 Qwen3-VL 处理极长序列输入的能力。

预训练数据

图像标题与交错图文数据

图像标题数据: 从网络来源收集大规模当代中英多语言图文对,应用以专门微调的 Qwen2.5-VL-32B 模型为中心的多阶段精炼流水线。该模型利用每张图像的原始文本生成更全面、流畅、细粒度的标题——丰富视觉元素描述(如对象属性、空间布局、上下文语义),同时提高文本组件的语言质量和信息量。

交错图文数据: 收集来自最新中英文网站的多样化真实多模态文档。所有文档使用轻量级 Qwen 分类器进行细粒度领域识别,系统性排除广告、推广内容和标题党等低价值类别。

对于书籍规模的交错数据,使用微调的 Qwen2.5-VL-7B 模型进行高精度多模态解析,精确提取和对齐文本与嵌入的图形、图表和照片。为支持超长上下文建模,将连续页面合并为最长 256K token 的序列,保留自然页面顺序和多模态一致性。

知识数据

世界知识对多模态大语言模型实现鲁棒的视觉理解、基于推理和跨实体感知生成至关重要。Qwen3-VL 构建了以涵盖十多个语义类别的明确实体为中心的大规模预训练数据集——包括动物、植物、地标、食物和日常物品(如车辆、电子产品、服装)。

现实世界实体遵循长尾分布:突出概念出现频繁且标注质量高,而大多数概念稀少。为此采用基于重要性的采样策略:高显著性实体采样更多以确保充分学习信号,低显著性实体以较小比例纳入以保持广泛覆盖。

OCR、文档解析与长文档理解

OCR: 为增强真实图像的 OCR 性能,使用粗到细的流水线整理 3000 万内部收集样本。该流水线整合 OCR 专门模型的伪标签和 Qwen2.5-VL 的精炼——无需任何人工标注。Qwen2.5-VL 支持 10 种语言(不含中英文),Qwen3-VL 额外整合 29 种语言,合成约 3000 万高质量多语言 OCR 样本并整理超过 100 万真实世界多语言图像。

文档解析: 从 Common Crawl 收集 300 万 PDF,均匀分布在 10 种文档类型(每种 30 万样本),以及 400 万内部文档。内部布局模型首先预测阅读顺序和文本/非文本区域的边界框,Qwen2.5-VL-72B 然后进行区域特定识别。设计统一的标注框架支持两种表示:QwenVL-HTML(包含细粒度元素级边界框)和 QwenVL-Markdown(仅定位图像和表格,表格以 LaTeX 编码)。

长文档理解: 利用大规模长文档数据语料增强多页 PDF 理解能力。通过合并单页文档样本合成长文档解析序列,每序列开头放置多个页面图像,后接 OCR 或 HTML 解析的对应文本。

🚀 后训练

后训练包含三个阶段:

- 监督微调(SFT): 在长思维链数据上进行监督微调

- 知识蒸馏: 从更强的教师模型进行知识蒸馏

- 强化学习(RL): 强化学习训练

为平衡纯文本和多模态学习目标,应用平方根重加权,在不损害文本能力的情况下提升多模态性能。此外,为后训练阶段分配额外计算资源以进一步提升模型性能。

在相当 token 预算和延迟约束下,Qwen3-VL 在稠密和 MoE 架构上均实现了更优性能。模型发布非思考和思考两种变体以满足不同应用需求。

🎯 评估结果

STEM 推理

在 MMMU、MathVision、MathVista 等 12 个多模态推理基准上评估 Qwen3-VL 系列。旗舰模型 Qwen3-VL-235B-A22B 在「非思考」和「思考」模型中均展现出出色性能。Instruct 变体在 MathVista、MathVision、MathVerse、DynaMath、ZeroBench、VLMsAreBlind、VisuLogic 等多个基准上取得非思考模型中的最佳结果;Thinking 变体在 MathVista、MathVision、MathVerse、ZeroBench、LogicVista、VisuLogic 上达到 SOTA。

| 模型 | MMMU | MathVista | MathVision | ZeroBench | VisuLogic |

|---|---|---|---|---|---|

| Qwen3-VL-235B-A22B (Thinking) | 80.6 | 85.8 | 74.6 | 4 | 34.4 |

| Qwen3-VL-235B-A22B (Instruct) | 78.7 | 84.9 | 66.5 | 2 | 29.9 |

| Gemini 2.5 Pro (Thinking) | 81.7 | 82.7 | 73.3 | 3 | 31.6 |

| GPT-5 (High) | 84.2 | 81.3 | 70.9 | 2 | 28.5 |

中型模型中,Qwen3-VL-32B 相比 Gemini-2.5-Flash 和 GPT-5-mini 展现显著优势,在推理任务上已超越上一代 Qwen2.5-VL-72B:

| 模型 | MMMU | MathVista | DocVQA | OCRBench | MMBench-EN |

|---|---|---|---|---|---|

| Qwen3-VL-32B (Thinking) | 78.1 | 85.9 | 96.1 | 855 | 89.5 |

| Qwen3-VL-32B (Instruct) | 76.0 | 83.8 | 96.9 | 895 | 87.6 |

| Gemini 2.5 Flash (Thinking) | 77.7 | 79.4 | 92.8 | 853 | 87.1 |

| GPT-5 mini (High) | 79.0 | 79.1 | 90.5 | 821 | 86.6 |

小模型系列中,Qwen3-VL-8B 在所有五个基准上取得最高性能,从 2B 到 8B 呈现清晰的性能提升趋势。值得注意的是,Qwen3-VL-8B-Thinking 在 MathVista 上取得 81.4 分,接近旗舰模型的 85.8 分。

通用视觉问答

在 MMBench-V1.1、RealWorldQA、MMStar、SimpleVQA 等通用 VQA 基准上全面评估。Qwen3-VL 家族在从 2B 到 235B 的广泛模型规模上展现出强大且极具竞争力的性能。

旗舰模型对比(非推理模式):Qwen3-VL-235B-A22B-Instruct 在 MMBench-EN/MMBench-CN 上取得 89.3/88.9 的最高分,RealWorldQA 上取得 79.2 的最佳结果。

中型模型对比:Qwen3-VL-32B-Thinking 在 MMBench-EN/MMBench-CN 上取得 89.5/89.4,RealWorldQA 上取得 79.4 的最高分。

文档理解与 OCR

Qwen3-VL 特别强调增强长文档理解能力。在 MMLongBench-Doc 基准上,旗舰模型在 instruct/thinking 设置下分别达到 57.0%/56.2% 的准确率,实现长文档理解任务的 SOTA 性能。

在 OCR 相关基准上,Qwen3-VL-235B-A22B-Instruct 在 CC-OCR 和 OmniDocBench 以及 OCRBench、OCRBench_v2 等综合 OCR 基准上建立新的 SOTA,略优于其 Thinking 变体。

| 模型 | DocVQA | InfoVQA | OCRBench | CharXiv(RQ) |

|---|---|---|---|---|

| Qwen3-VL-235B-A22B (Thinking) | 96.5 | 89.5 | 875 | 66.1 |

| Qwen3-VL-235B-A22B (Instruct) | 97.1 | 89.2 | 920 | 62.1 |

| Gemini 2.5 Pro (Thinking) | 92.6 | 84.2 | 866 | 67.9 |

| GPT-5 (High) | 91.5 | 79.0 | 810 | 81.1 |

多语言 OCR 扩展: Qwen3-VL 从 Qwen2.5-VL 的 10 种非英/中语言扩展到支持 39 种语言。在内部测试集上,模型在 39 种语言中的 32 种上准确率超过 70%,展现出强大且实用的多语言 OCR 能力。

2D/3D 定位

在 RefCOCO/+/g 指代表达理解基准、开放词汇目标检测基准 ODinW-13 和计数基准 CountBench 上评估 2D 定位能力。旗舰模型 Qwen3-VL-235B-A22B 在所有 2D 定位和计数基准上取得 SOTA 结果,在 ODinW-13 上达到 48.6 mAP,展示强大的多目标开放词汇目标定位能力。

在 3D 目标定位方面,Qwen3-VL 在 Omni3D 综合基准(包含 ARKitScenes、Hypersim、SUN RGB-D 数据集)上进行评估。在 SUN RGB-D 数据集上,Thinking 变体超越 Gemini-2.5-Pro 5.2 个百分点。

具身与空间理解

在 ERQA、VSIBench、EmbSpatial、RefSpatial、RoboSpatialHome 等具身和空间理解基准上评估 Qwen3-VL。这一成功很大程度上源于模型在高分辨率视觉数据上的训练,包含细粒度指向、相对位置标注和 QA 对,产生了深刻的空间理解能力。

Qwen3-VL-235B-A22B 在 EmbSpatial、RefSpatial 和 RoboSpatialHome 上分别取得 84.3、69.9 和 73.9 分,在 ERQA 和 VSIBench 上取得 52.5 和 60.0 的顶级分数。

多图像理解

在 BLINK 和 MUIRBENCH 两个多图像基准上评估 Qwen3-VL。Qwen3-VL 在多图像理解上展现出整体优势:Instruct 变体在 BLINK 上取得与 Gemini-2.5-Pro 相当的性能,Thinking 变体在 MUIRBENCH 上取得 80.1 的领先分数,超越所有其他模型。

视频理解

得益于训练数据规模扩展和关键架构增强,Qwen3-VL 的视频理解能力显著提升。交错 MRoPE 的整合、文本时间戳的插入和时间密集视频标题的扩展,使 Qwen3-VL 8B 变体能够达到与显著更大的 Qwen2.5-VL 72B 模型相当的性能。

在 VideoMME、MVBench、Charades-STA、VideoMMMU、MMVU、LVBench、MLVU 等多样化视频理解任务上全面评估。与 Gemini 2.5 Pro、GPT-5、Claude Opus 4.1 等 SOTA 专有模型相比,Qwen3-VL 展现出竞争性甚至在多个任务上更优的性能。

| 模型 | MVBench | Video-MME | MLVU | LVBench | VideoMMMU |

|---|---|---|---|---|---|

| Qwen3-VL-235B-A22B (Thinking) | 75.2 | 79.0 | 83.8 | 63.6 | 80.0 |

| Qwen3-VL-235B-A22B (Instruct) | 76.5 | 79.2 | 84.3 | 67.7 | 74.7 |

| Gemini 2.5 Pro (Thinking) | 69.9 | 85.1 | 85.6 | 73.0 | 83.6 |

| GPT-5 (High) | 75.3 | 84.7 | 86.2 | - | 84.6 |

旗舰模型 Qwen3-VL-235B-A22B-Instruct 在标准视频理解基准上与 Gemini 2.5 Pro(budget-128)和 GPT-5 minimal 等领先模型相当。通过将上下文窗口扩展到 256K token,在长视频评估任务(特别是 MLVU)上达到甚至超越 Gemini-2.5-Pro 的性能。

8B vs 72B 效率对比: 架构增强使 Qwen3-VL-8B 在视频理解任务上达到与 Qwen2.5-VL-72B 相当的性能,而参数量仅为后者的 1/9。这表明交错 MRoPE 和文本时间戳等架构创新对视频理解能力的提升远超单纯增加参数规模。

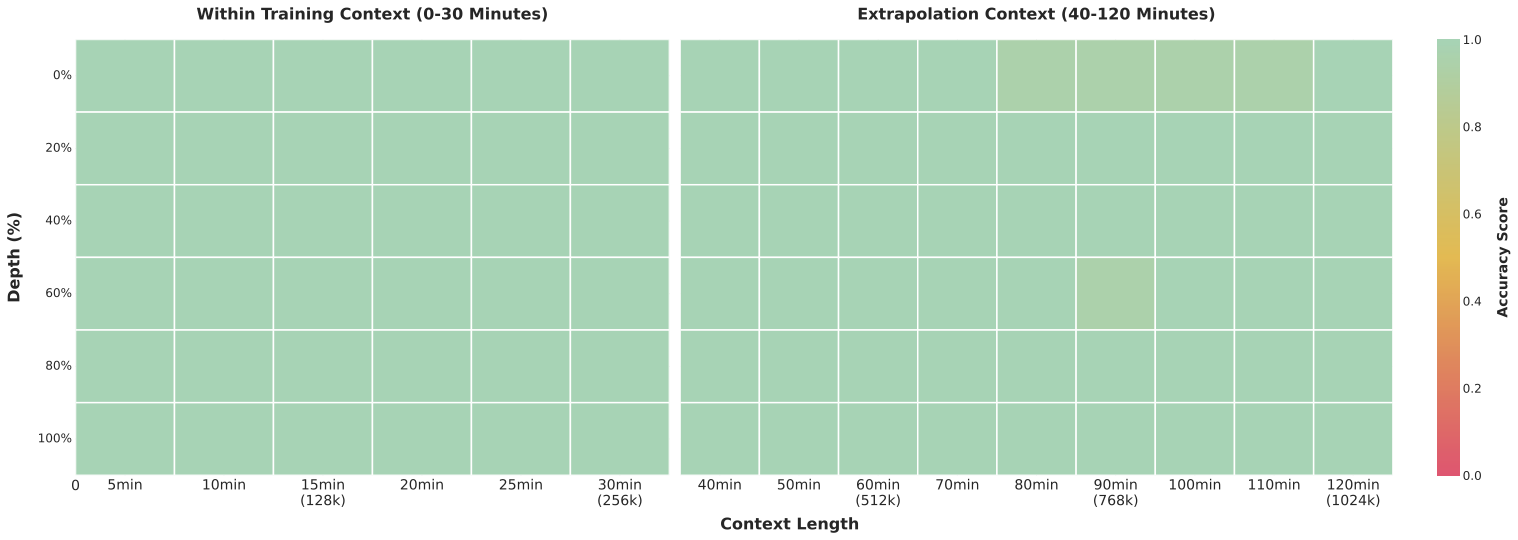

长上下文:Needle-in-a-Haystack

为评估长上下文处理能力,构建视频「Needle-in-a-Haystack」评估。任务要求模型从长视频中准确定位包含关键视觉证据的「针」帧并回答相关问题。视频以 1 FPS 均匀采样,帧分辨率动态调整以保持恒定的视觉 token 预算。

模型在长达 30 分钟的视频(对应 256K token 上下文长度)上实现 100% 准确率。通过 YaRN 位置扩展,即使在长达 1M token 的序列(约 2 小时视频)上,模型仍保持 99.5% 的高准确率。这有力证明了模型强大的长序列建模能力。

多模态 Agent 与代码

在 ScreenSpot Pro、OSWorldG、AndroidWorld、OSWorld、WindowsAA 等 GUI Agent 基准上评估 Qwen3-VL 的智能体能力。旗舰模型在 ScreenSpot Pro 上取得 61.8/62.0,在 OSWorld 上取得 38.1 分,展现出强大的 GUI 理解和决策能力。

在 Design2Code、ChartMimic、UniSVG 等多模态代码基准上,Qwen3-VL-235B-A22B-Thinking 在 Design2Code 上取得 93.4 分,ChartMimic 上取得 80.5 分,展现出将视觉设计转化为代码的强大能力。

纯文本能力

为确保 Qwen3-VL 在多模态能力之外保持强大的纯文本能力,在知识、推理、代码、对齐任务、Agent、多语言六大类基准上全面评估。

旗舰模型(235B-A22B)对比:

| 基准 | Qwen3-VL-235B-A22B (Instruct) | Qwen3-235B-A22B (Instruct-2507) | DeepSeek V3 0324 | Claude-Opus-4 |

|---|---|---|---|---|

| MMLU-Pro | 81.8 | 83.0 | 81.2 | 86.6 |

| AIME-25 | 74.7 | 70.3 | 46.6 | 33.9 |

| LiveCodeBench v6 | 54.3 | 51.8 | 45.2 | 44.6 |

| BFCL-v3 | 67.7 | 70.9 | 64.7 | 60.1 |

Qwen3-VL-235B-A22B-Instruct 在推理和代码任务上显著超越其他模型。值得注意的是,DeepSeek V3 0324 和 Qwen3-235B-A22B-Instruct-2507 是纯语言模型,而 Qwen3-VL-235B-A22B-Instruct 是视觉语言模型——这表明 Qwen3-VL 已实现视觉和文本能力的统一。

中型模型(32B/30B-A3B): Qwen3-VL-32B 和 Qwen3-VL-30B-A3B 在所有基准上显著优于对应的纯文本 Qwen3 模型,证明多模态训练不仅未损害语言能力,反而有所增强:

| 基准 | Qwen3-VL-32B (Thinking) | Qwen3-32B (Thinking) | Qwen3-VL-32B (Instruct) | Qwen3-32B (Instruct) |

|---|---|---|---|---|

| AIME-25 | 83.7 | 72.9 | 66.2 | 20.2 |

| LiveCodeBench v6 | 65.6 | 60.6 | 43.8 | 29.1 |

| IFEval | 87.8 | 85.0 | 84.7 | 83.2 |

| WritingBench | 86.2 | 78.4 | 82.9 | 81.3 |

Qwen3-VL-32B-Thinking 在 AIME-25 上以 83.7 分超越纯文本版本 10.8 个百分点,在 LiveCodeBench v6 上超越 5 个百分点,充分证明视觉语言模型可以在保持甚至超越纯文本模型的语言能力。

小模型(8B/4B/2B): 端侧模型同样展现出令人印象深刻的性能:

| 基准 | Qwen3-VL-8B (Thinking) | Qwen3-8B (Thinking) | Qwen3-VL-8B (Instruct) | Qwen3-8B (Instruct) |

|---|---|---|---|---|

| AIME-25 | 80.3 | 67.3 | 45.9 | 20.9 |

| LiveCodeBench v6 | 58.6 | 51.0 | 39.3 | 25.5 |

| GPQA | 69.9 | 62.0 | 61.9 | 39.3 |

| PolyMATH | 47.5 | 42.7 | 30.4 | 18.8 |

视觉语言统一: Qwen3-VL 在纯文本基准上不仅没有退化,反而普遍超越其文本专属对应版本。例如 Qwen3-VL-32B-Thinking 在 AIME-25 上比 Qwen3-32B-Thinking 高 10.8 分,表明多模态训练带来的跨模态知识迁移有效提升了整体推理能力。

💡 结论

Qwen3-VL 是 Qwen 系列目前最强大的视觉语言模型,通过三大架构创新——交错 MRoPE、DeepStack 视觉语言对齐、基于文本的时间戳定位——在广泛的多模态基准上实现了领先性能,同时保持了强大的纯文本能力。

原生支持 256K token 交错序列使模型能够对长文档、图像序列和视频进行鲁棒推理,在 Needle-in-a-Haystack 测试中展现出 100% 的长上下文检索准确率。从 2B 到 235B 的稠密和 MoE 变体确保了跨延迟和质量需求的灵活部署。

核心成果: Qwen3-VL-235B-A22B 在 STEM 推理(MMMU 80.6、MathVista 85.8)、文档理解(DocVQA 97.1、InfoVQA 89.5)、视频理解(MLVU 84.3)等关键基准上实现 SOTA 或接近 SOTA 性能。更令人瞩目的是,在相当规模下,Qwen3-VL 在纯文本基准上超越了其文本专属对应版本,真正实现了「视觉语言统一」。

权衡与局限: 尽管整体性能优异,Qwen3-VL 在某些任务上仍有改进空间。例如在 CharXiv 推理子集上,GPT-5 (High) 取得 81.1 分,显著领先于 Qwen3-VL 的 66.1 分。在 Agent 任务如 TAU2 系列基准上,OpenAI o3 仍保持明显优势。这反映了当前 VLM 在复杂工具调用和多步规划任务上的通用挑战。

展望未来,Qwen3-VL 将作为具身 AI 智能体的基础引擎,不仅感知和推理丰富的多模态输入,还能在动态环境中执行果断、上下文感知的行动。未来的工作将专注于扩展交互感知、工具增强推理和实时多模态控制能力,并探索统一的理解-生成架构,利用视觉生成能力进一步提升整体智能。通过 Apache 2.0 许可证开源整个模型家族,期待推动社区创新,共同迈向真正集成的多模态 AI 智能体愿景。