Kimi K2.5——技术报告详解

引言: Kimi K2.5 是 Moonshot AI 推出的开源多模态智能体模型,基于 Kimi K2 的万亿参数 MoE 架构,通过「文本-视觉联合优化」和「Agent Swarm 并行智能体框架」两大核心创新,在推理、编码、视觉理解、智能体任务等多个领域实现 SOTA 性能。Agent Swarm 在 WideSearch 上将推理延迟降低 4.5 倍,BrowseComp 准确率从 60.6% 提升至 78.4%。

✈️ 引言

大语言模型正在快速向智能体能力演进。GPT-5.2、Claude Opus 4.5、Gemini 3 Pro 等模型在工具调用和推理方面展现出显著进展,能够将复杂问题分解为多步计划并执行长序列的交错推理与行动。

然而,现有智能体系统主要依赖顺序执行,即使是能进行数百步推理的模型(如 Kimi K2-Thinking),也面临推理时间线性增长的问题。随着智能体任务复杂度和异构性的增加——例如构建一个涉及大规模研究、设计和开发的复杂项目——顺序执行范式变得越来越低效。

Kimi K2.5 从两个关键方面改进了智能体能力:

文本-视觉联合优化。 传统方法在训练后期以高比例注入视觉 token,K2.5 发现早期融合配合较低视觉比例效果更好。原生多模态预训练、零视觉 SFT 和联合 RL 使视觉能力增强文本性能——MMLU-Pro 从 84.7% 提升至 86.4%,实现了双向增强。

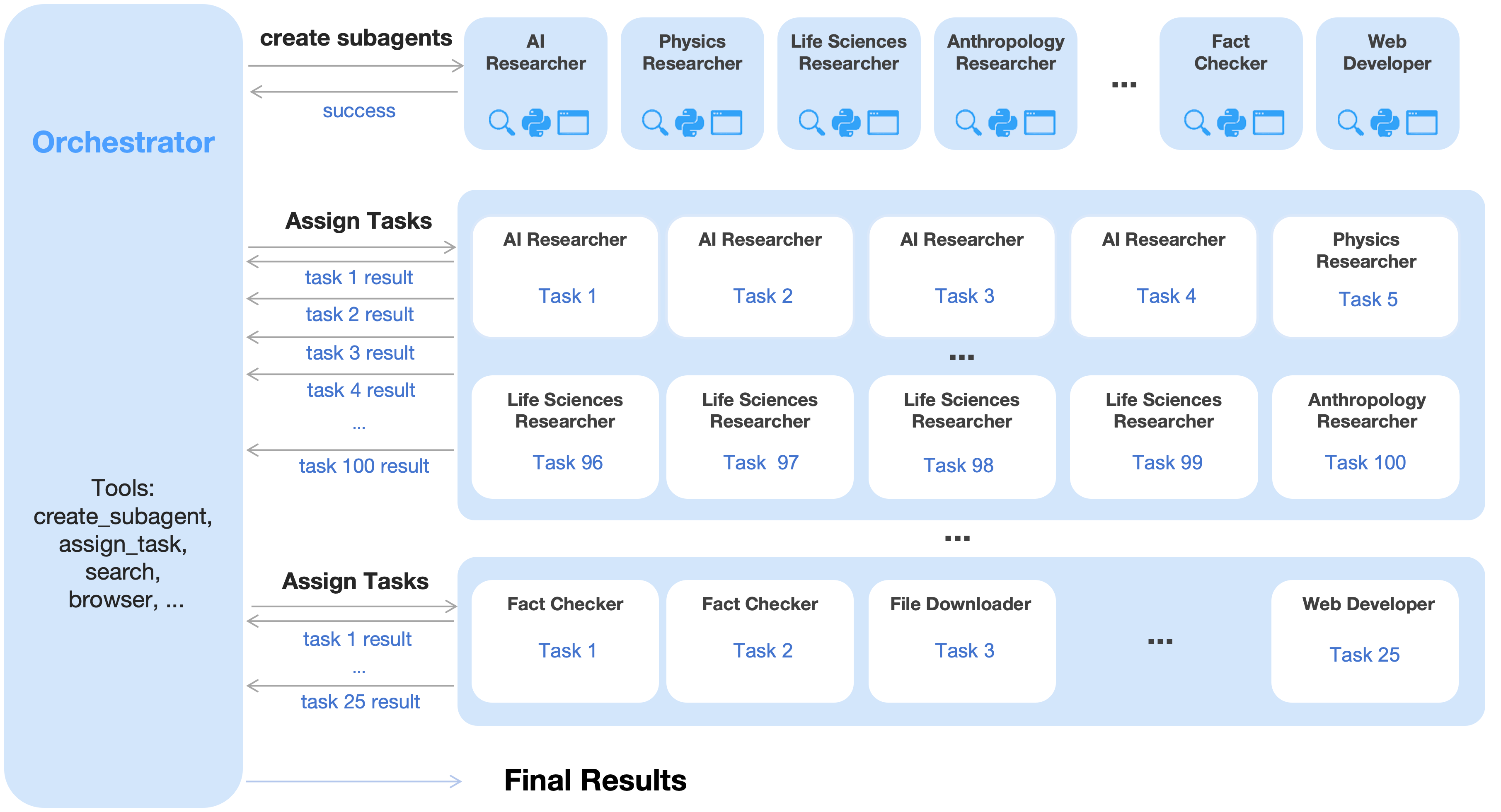

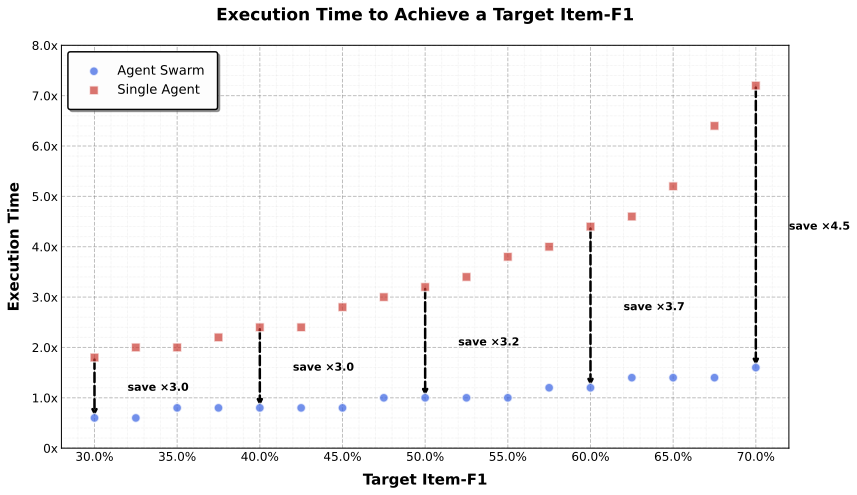

Agent Swarm 并行智能体编排。 提出 PARL(Parallel-Agent Reinforcement Learning)范式,通过可训练的编排器动态创建子智能体并并行执行子任务,将任务复杂度从线性扩展转化为并行处理,在 WideSearch 上实现 3-4.5 倍的延迟降低。

阅读提示: 本文按原文结构依次介绍文本-视觉联合优化、Agent Swarm 架构、训练流程和全面评估结果。旗舰模型 Kimi K2.5 在 BrowseComp(78.4%)、OSWorld-Verified(63.3%)、VideoMMMU(86.6%)等基准上取得 SOTA 或接近 SOTA 性能。

🏗️ 文本-视觉联合优化

Kimi K2.5 是在约 15 万亿混合视觉和文本 token 上进行大规模联合预训练的原生多模态模型。与视觉适配模型往往牺牲语言或视觉能力不同,联合预训练范式同时增强两种模态。

原生多模态预训练

多模态预训练的一个关键设计问题是:给定固定的视觉-文本 token 预算,什么是最优的联合训练策略?常规做法是在 LLM 训练的后期阶段以高比例(如 50% 或更高)引入视觉 token。

然而,实验揭示了不同的情况。在保持总视觉和文本 token 预算固定的前提下,消融实验表明早期融合配合较低视觉比例能产生更好结果:

| 策略 | 视觉注入时机 | 视觉:文本比例 | 视觉知识 | 视觉推理 | OCR | 文本知识 | 文本推理 | 代码 |

|---|---|---|---|---|---|---|---|---|

| Early | 0% | 10%:90% | 25.8 | 43.8 | 65.7 | 45.5 | 58.5 | 24.8 |

| Mid | 50% | 20%:80% | 25.0 | 40.7 | 64.1 | 43.9 | 58.6 | 24.0 |

| Late | 80% | 50%:50% | 24.2 | 39.0 | 61.5 | 43.1 | 57.8 | 24.0 |

这推动了原生多模态预训练策略:采用适中的视觉比例并在训练早期整合,使模型自然发展平衡的多模态表示,同时受益于两种模态的持续协同优化。

零视觉 SFT

预训练的 VLM 不能自然执行基于视觉的工具调用,这对多模态 RL 构成了冷启动问题。常规方法通过人工标注或提示工程构建 CoT 数据,但这类方法多样性有限,往往将视觉推理限制在简单图表和原始工具操作(裁剪、旋转、翻转)。

一个观察是高质量文本 SFT 数据相对丰富且多样。K2.5 提出零视觉 SFT——仅使用文本 SFT 数据激活视觉智能体能力。所有图像操作通过 IPython 中的程序化操作代理,有效泛化了传统视觉工具使用。这种「零视觉」激活使模型能够执行像素级操作(如通过二值化和计数估计对象大小),并泛化到视觉定位、计数和 OCR 等任务。

实验表明,零视觉 SFT 足以激活视觉能力同时确保跨模态泛化。这很可能归因于文本和视觉数据的联合预训练——相比零视觉 SFT,文本-视觉 SFT 在视觉智能体任务上表现更差,可能是因为缺乏高质量视觉数据。

联合多模态强化学习

基于结果的视觉 RL。 在零视觉 SFT 之后,模型需要进一步精调以可靠地将视觉输入整合到推理中。文本发起的激活存在明显失败模式:视觉输入有时被忽略,图像在必要时未被关注。

作者在明确需要视觉理解的任务上应用基于结果的 RL,分为三个领域:

- 视觉定位和计数:图像内对象的准确定位和枚举

- 图表和文档理解:结构化视觉信息的解释和文本提取

- 视觉关键 STEM 问题:筛选需要视觉输入的数学和科学问题

基于结果的 RL 不仅改善了基础视觉能力,还增强了更复杂的智能体行为。提取这些轨迹用于拒绝采样微调(RFT)构建了自改进数据流水线。

视觉 RL 改善文本性能。 为调查视觉和文本性能之间的潜在权衡,作者评估了视觉 RL 前后的纯文本基准。令人惊讶的是,基于结果的视觉 RL 在文本任务上产生了可测量的改进:

| 基准 | 视觉 RL 前 | 视觉 RL 后 | 改进 |

|---|---|---|---|

| MMLU-Pro | 84.7% | 86.4% | +1.7% |

| GPQA-Diamond | 84.3% | 86.4% | +2.1% |

| LongBench v2 | 56.7% | 58.9% | +2.2% |

分析表明,视觉 RL 增强了需要结构化信息提取的领域的校准能力,减少了类似视觉接地推理(如计数、OCR)查询的不确定性。这些发现表明视觉 RL 可以促进跨模态泛化,在不损害语言能力的情况下改善文本推理。

跨模态双向增强: 文本引导视觉、视觉精炼文本。联合预训练建立的视觉-文本对齐使能力自然跨模态泛化,视觉 RL 不仅没有损害文本能力,反而将 MMLU-Pro 提升了 1.7 个百分点。这是联合训练实现优异跨模态对齐的有力证据。

联合多模态 RL。 受 robust 视觉能力可从零视觉 SFT 配合视觉 RL 涌现(并进一步增强通用文本能力)的发现启发,K2.5 在后训练中采用联合多模态 RL 范式。不同于传统的模态特定专家划分,RL 域按能力组织——知识、推理、编码、智能体等——而非按输入模态。这些域专家同时从纯文本和多模态查询中学习,生成奖励模型(GRM)同样在异构轨迹上进行优化。

🤖 Agent Swarm

现有智能体系统的主要挑战在于依赖推理和工具调用的顺序执行。虽然这种结构对简单的短视程任务有效,但随着任务复杂度增加和累积上下文增长,顺序系统会遇到显著瓶颈。单个智能体逐步执行的能力有限,最终会耗尽实际推理深度和工具调用预算。

架构与学习设置

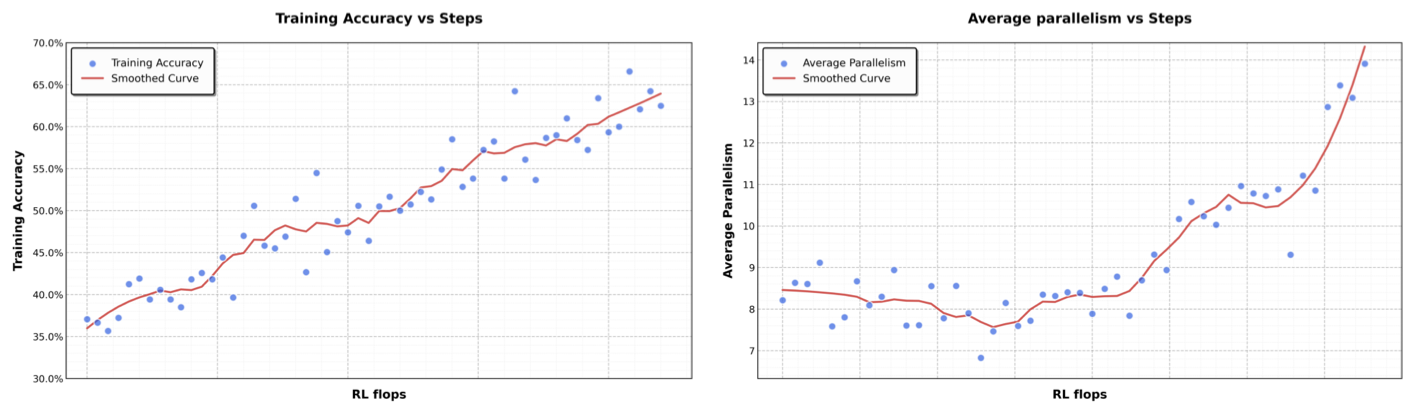

K2.5 引入 Agent Swarm 和 PARL(Parallel-Agent Reinforcement Learning)。不同于将任务执行为推理链或依赖预定义并行启发式,K2.5 通过动态任务分解、子智能体实例化和并行子任务调度启动 Agent Swarm。重要的是,并行性并非固有优势——是否、何时以及如何并行的决策通过环境反馈和 RL 驱动的探索显式学习。

PARL 框架采用解耦架构,包含可训练的编排器和从固定中间策略检查点实例化的冻结子智能体。这种设计刻意避免端到端协同优化,以规避两个根本挑战:信用分配模糊和训练不稳定。

在多智能体设置中,基于结果的奖励本质上是稀疏和嘈杂的——正确答案不能保证子智能体执行完美,失败也不能意味着所有子智能体都有错误。通过冻结子智能体并将其输出视为环境观察而非可微决策点,高层协调逻辑与底层执行能力解耦,实现更鲁棒的收敛。

PARL 奖励函数

训练可靠的并行编排器面临独立子智能体执行固有的延迟、稀疏和非平稳反馈挑战。PARL 奖励函数定义为:

性能奖励

缓解「串行崩溃」——编排器默认单智能体执行的局部最优。通过激励子智能体实例化,鼓励探索并发调度空间。 关注已分配子任务的成功完成,防止「虚假并行」——编排器通过生成大量无意义子智能体来增加并行指标。

为确保最终策略优化主要目标,超参数

关键步数作为资源约束

为在并行智能体设置中衡量计算时间成本,通过类比计算图中的「关键路径」定义关键步数。将一个 episode 建模为执行阶段序列

设

通过关键步数而非总步数约束训练和评估,框架显式激励有效并行化。不能减少并行组最大执行时间的过多子任务创建在此指标下收益甚微,而缩短最长并行分支的平衡任务分解直接减少关键步数。结果,编排器被鼓励以最小化端到端延迟的方式在子智能体间分配工作。

并行智能体能力诱导的提示构建

为激励编排器利用并行化优势,作者构建了一套合成提示来挑战顺序智能体执行的极限。这些提示强调广度搜索(需要同时探索多个独立信息源)或深度搜索(需要带延迟聚合的多推理分支),还包括受真实工作负载启发的任务(长上下文文档分析、大规模文件下载)。

顺序执行时,这些任务难以在固定的推理步数和工具调用预算内完成。通过构造,它们鼓励编排器并行分配子任务,使完成所需的关键步数少于单顺序智能体可行步数。重要的是,提示不显式指示模型并行化,而是塑造任务分布使并行分解和调度策略自然被青睐。

📊 训练流程

基座模型

Kimi K2.5 的基座是 Kimi K2——一个万亿参数的 MoE Transformer 模型,在 15 万亿高质量文本 token 上预训练。Kimi K2 采用 token 高效的 MuonClip 优化器和 QK-Clip 实现训练稳定性,总参数 1.04 万亿,激活参数 320 亿,使用 384 个专家(每 token 激活 8 个)。

模型架构

Kimi K2.5 的多模态架构包含三个组件:三维原生分辨率视觉编码器(MoonViT-3D)、MLP 投影器和 Kimi K2 MoE 语言模型。

MoonViT-3D:图像和视频的共享嵌入空间。 在 Kimi-VL 中,MoonViT 原生处理原始分辨率图像,无需复杂的子图分割和拼接操作。从 SigLIP-SO-400M 初始化,MoonViT 融合 NaViT 的 patch packing 策略,使不同分辨率图像能同时高效训练。

为最大化图像理解能力向视频迁移,K2.5 引入 MoonViT-3D——统一架构、完全共享参数、一致嵌入空间。将「patch n’ pack」理念扩展到时间维度:最多四个连续帧被视为时空体,来自这些帧的 2D patch 联合展平并打包成单个 1D 序列,使相同的注意力机制无缝跨空间和时间操作。额外的 temporal attention 改善了对高速运动和视觉效果的理解,共享最大化了从静态图像到动态视频的知识泛化。

在 MLP 投影器之前,轻量级时间池化在每个时间块内聚合 patch,产生 4 倍时间压缩,显著扩展可处理视频长度。

预训练流水线

| 阶段 | ViT 训练 | 联合预训练 | 联合长上下文中训练 |

|---|---|---|---|

| 数据 | Alt text、合成标题、定位、OCR、视频 | + 文本、知识、交错、视频、OS 截图 | + 高质量文本/多模态、长文本/视频、推理、长 CoT |

| 序列长度 | 4096 | 4096 | 32768→262144 |

| Token | 1T | 15T | 500B→200B |

| 训练 | ViT | ViT & LLM | ViT & LLM |

ViT 训练阶段。 MoonViT-3D 从 SigLIP 持续预训练,使用图像-文本和视频-文本对,文本组件包括多种目标:图像 alt text、图像和视频合成标题、定位边界框、OCR 文本。采用两阶段对齐策略:第一阶段更新 MoonViT-3D 通过标题损失与 Moonlight-16B-A3B 对齐,消耗约 1T token;第二阶段仅更新 MLP 投影器将 ViT 与 1T LLM 桥接。

联合训练阶段。 联合预训练从接近结束的 Kimi K2 检查点继续,使用额外 15T 视觉-文本 token。数据配方扩展 Kimi K2 的预训练分布,引入独特 token,增加编码相关内容的权重。第三阶段执行长上下文激活,通过 YaRN 插值顺序扩展上下文长度。

后训练

监督微调。 继承 Kimi K2 的 SFT 流水线,从 K2、K2 Thinking 和一系列专有专家模型合成高质量候选响应。数据生成策略采用针对特定领域的专门流水线,整合人工标注与高级提示工程和多阶段验证,产生大规模指令调优数据集。

强化学习。 强化学习是后训练的关键阶段。为促进文本和视觉模态的联合优化并实现智能体群的 PARL,开发了统一智能体强化学习环境。对于每个问题

其中

Token 高效强化学习。 Token 效率对于具有测试时扩展的 LLM 至关重要。然而观察到长度过拟合现象:在刚性预算约束下训练的模型往往无法泛化到更高计算规模。

作者提出 Toggle——一种在「测试时扩展」和「预算约束优化」之间交替的训练启发式:

算法每

- Phase 0(预算限制阶段):模型被训练在任务相关 token 预算内解决问题。为防止过早牺牲质量换取效率,此约束仅在问题平均准确率超过阈值

时执行。 - Phase 1(标准扩展阶段):模型生成响应直到最大 token 限制,鼓励模型利用计算获得更好的测试时扩展。

实验表明,Toggle 在几乎所有基准上实现 25-30% 的输出 token 减少,对性能影响可忽略。且当仅在数学和编程任务上训练时,模型在 GPQA 和 MMLU-Pro 上仍实现一致的 token 减少,展现强领域泛化。

Toggle 的效率收益: 在推理能力保持的同时,平均减少 25-30% 输出 token。冗余模式(如重复验证和机械计算)显著减少。Toggle 专门设计用于协调推理能力和计算效率。

训练基础设施

解耦编码器过程(DEP)。 在典型的使用流水线并行的多模态训练中,视觉编码器和文本嵌入共置于流水线的第一阶段(Stage-0)。然而由于多模态输入大小的固有变化(如图像数量和分辨率),Stage-0 在计算负载和内存使用上波动剧烈。

利用视觉编码器在计算图中的独特拓扑位置——作为前向传播的起点和反向传播的终点——K2.5 采用 DEP(Decoupled Encoder Process),每个训练步骤包含三个阶段:

- 平衡视觉前向:首先执行全局批次中所有视觉数据的前向传播。视觉编码器较小,在所有 GPU 上复制。前向计算负载根据负载指标均匀分布。

- 骨干训练:执行主 transformer 骨干的前向和反向传播。由于前一阶段丢弃了中间激活,现可充分利用纯文本训练验证的任何高效并行策略。

- 视觉重计算与反向:重新计算视觉编码器前向传播,随后执行反向传播计算视觉编码器参数的梯度。

DEP 不仅实现负载均衡,还解耦了视觉编码器和主骨干的优化策略。K2.5 无缝继承 K2 的并行策略,实现多模态训练效率达到纯文本训练的 90%。

🎯 评估结果

主评估设置

评估覆盖六大能力轴:推理与通用、编码、智能体能力、图像理解、视频理解、计算机使用。

推理与通用

Kimi K2.5 在严格的 STEM 基准上与顶级专有模型竞争。AIME 2025 得分 96.1%,接近 GPT-5.2 的满分,超越 Claude Opus 4.5(92.8%)和 Gemini 3 Pro(95.0%)。HMMT 2025 达到 95.4%,IMO-AnswerBench 达到 81.8%,展现卓越的推理深度。

| 基准 | Kimi K2.5 | Claude Opus 4.5 | GPT-5.2 | Gemini 3 Pro |

|---|---|---|---|---|

| AIME 2025 | 96.1 | 92.8 | 100 | 95.0 |

| HMMT Feb 2025 | 95.4 | 92.9* | 99.4 | 97.3* |

| GPQA-Diamond | 87.6 | 87.0 | 92.4 | 91.9 |

| MMLU-Pro | 87.1 | 89.3* | 86.7* | 90.1 |

| HLE-Full w/ tools | 50.2 | 43.2 | 45.5 | 45.8 |

在不使用工具的 HLE 上,K2.5 达到 30.1%;启用工具后提升至 50.2%,显著超越 Gemini 3 Pro(45.8%)和 GPT-5.2(45.5%)。

复杂编码与软件工程

K2.5 展现强大的软件工程能力,特别是在实际编码和维护任务上。SWE-Bench Verified 达到 76.8%,SWE-Bench Multilingual 达到 73.0%,超越 Gemini 3 Pro 同时与 Claude Opus 4.5 和 GPT-5.2 竞争。LiveCodeBench v6 达到 85.0%,超越 DeepSeek-V3.2(83.3%)和 Claude Opus 4.5(82.2%)。

| 基准 | Kimi K2.5 | Claude Opus 4.5 | GPT-5.2 | Gemini 3 Pro |

|---|---|---|---|---|

| SWE-Bench Verified | 76.8 | 80.9 | 80.0 | 76.2 |

| LiveCodeBench v6 | 85.0 | 82.2* | - | 87.4* |

| Terminal Bench 2.0 | 50.8 | 59.3 | 54.0 | 54.2 |

| CyberGym | 41.3 | 50.6 | - | 39.9* |

智能体能力

K2.5 在复杂智能体搜索和浏览任务上建立新的 SOTA。BrowseComp 达到 60.6%(无上下文管理),使用 Discard-all 上下文管理后达到 74.9%,大幅超越 GPT-5.2 报告的 65.8%。WideSearch 达到 72.7% Item-F1。

| 基准 | Kimi K2.5 | Claude Opus 4.5 | GPT-5.2 | Gemini 3 Pro |

|---|---|---|---|---|

| BrowseComp | 60.6 | 37.0 | 65.8 | 37.8 |

| BrowseComp (w/ ctx) | 74.9 | 57.8 | 65.8 | 59.2 |

| BrowseComp (Swarm) | 78.4 | - | - | - |

| DeepSearchQA | 77.1 | 76.1* | 71.3* | 63.2* |

| Seal-0 | 57.4 | 47.7* | 45.0 | 45.5* |

Agent Swarm 结果

Agent Swarm 在三个代表性基准上评估:BrowseComp(深度推理)、WideSearch(大规模检索)、In-house Swarm Bench(真实世界高复杂度)。

| 基准 | K2.5 Agent Swarm | Kimi K2.5 | Claude Opus 4.5 | GPT-5.2 | GPT-5.2 Pro |

|---|---|---|---|---|---|

| BrowseComp | 78.4 | 60.6 | 37.0 | 65.8 | 77.9 |

| WideSearch | 79.0 | 72.7 | 76.2 | - | - |

| In-house Swarm Bench | 58.3 | 41.6 | 45.8 | - | - |

Agent Swarm 在 BrowseComp 上相比单智能体 K2.5(60.6%)实现 17.8% 的绝对提升,甚至超越 GPT-5.2 Pro(77.9%)。WideSearch Item-F1 提升 6.3%(72.7% → 79.0%),超越 Claude Opus 4.5(76.2%)建立新 SOTA。

执行时间节省。 在 WideSearch 上,Agent Swarm 相比单智能体基准减少 3-4.5 倍执行时间。如图所示,随着目标 Item-F1 从 30% 提升到 70%,单智能体执行时间从约 1.8 倍增长到超过 7.0 倍基准,而 Agent Swarm 保持在 0.6-1.6 倍的近恒定低延迟。

Agent Swarm 的双重收益: 不仅提升准确率(BrowseComp +17.8%、WideSearch +6.3%),还将推理延迟降低 3-4.5 倍。这源于并行编排将顺序工具调用转化为并行操作,防止了随任务难度增长的线性完成时间增长。

Agent Swarm 作为主动上下文管理。 不同于 Hide-Tool-Result、Summary、Discard-all 等测试时上下文截断策略(通过压缩或丢弃累积历史应对上下文溢出),Agent Swarm 通过显式编排实现主动上下文控制。长视程任务被分解为并行的语义隔离子任务,每个子任务由具有有界局部上下文的专门子智能体执行。这些子智能体维护独立的工作记忆,执行局部推理而不直接变更或污染中心编排器的全局上下文。

只有任务相关的输出——而非完整交互轨迹——被选择性路由回编排器。这种设计诱导上下文分片而非上下文截断,使系统能够沿额外的架构维度扩展有效上下文长度,同时保持模块化、信息局部性和推理完整性。

视觉理解

图像理解。 K2.5 展现强大的视觉推理和世界知识能力。MMMU-Pro 达到 78.5%,MathVision 达到 84.2%,MathVista (mini) 达到 90.1%(SOTA)。在 OCR 和文档理解上,CharXiv (RQ) 达到 77.5%,OCRBench 达到 92.3%(SOTA),InfoVQA 达到 92.6%(SOTA)。

| 基准 | Kimi K2.5 | Claude Opus 4.5 | GPT-5.2 | Gemini 3 Pro | Qwen3-VL-235B |

|---|---|---|---|---|---|

| MathVista (mini) | 90.1 | 80.2* | 82.8* | 89.8* | 85.8 |

| OCRBench | 92.3 | 86.5* | 80.7* | 90.3* | 920* |

| InfoVQA | 92.6 | 76.9* | 84* | 57.2* | 89.5 |

| ZeroBench | 9 | 3* | 9* | 8* | 4* |

视频理解。 K2.5 在多样化视频理解任务上实现 SOTA。VideoMMMU 达到 86.6%,MMVU 达到 80.4%。凭借 MoonViT-3D 的上下文压缩和密集时间理解能力,K2.5 在长视频理解上建立新 SOTA:LVBench 达到 75.9%,LongVideoBench 达到 79.8%(输入超过 2000 帧)。

| 基准 | Kimi K2.5 | Claude Opus 4.5 | GPT-5.2 | Gemini 3 Pro | Qwen3-VL-235B |

|---|---|---|---|---|---|

| VideoMMMU | 86.6 | 84.4* | 85.9 | 87.6 | 80.0 |

| LongVideoBench | 79.8 | 67.2* | 76.5* | 77.7* | 65.6* |

| LVBench | 75.9 | 57.3 | - | 73.5* | 63.6 |

计算机使用

K2.5 在真实世界任务上展现 SOTA 计算机使用能力。OSWorld-Verified 达到 63.3%,仅依赖 GUI 操作无需外部工具,大幅超越开源模型 Qwen3-VL-235B-A22B(38.1%)和 OpenAI 的 Operator (o3-based)(42.9%),与当前领先的 CUA 模型 Claude Opus 4.5(66.3%)竞争。WebArena 达到 58.9%,超越 OpenAI 的 Operator(58.1%),接近 Claude Opus 4.5(63.4%)。

| 基准 | Kimi K2.5 | Claude Opus 4.5 | GPT-5.2 | Qwen3-VL-235B |

|---|---|---|---|---|

| OSWorld-Verified | 63.3 | 66.3 | 8.6* | 38.1 |

| WebArena | 58.9 | 63.4* | - | 26.4* |

与竞品的差距: 尽管整体表现优异,K2.5 在某些基准上仍有差距。SimpleQA Verified(36.9% vs Gemini 3 Pro 的 72.1%)、HLE-Full(30.1% vs Gemini 3 Pro 的 37.5%)等知识密集型任务上与顶级竞品存在差距,反映了世界知识广度上的提升空间。

💡 结论

Kimi K2.5 展示了通过文本-视觉联合优化和并行智能体执行可以实现可扩展的通用智能体能力。通过在预训练和强化学习阶段统一语言和视觉,模型实现了强跨模态对齐和视觉-文本推理。Agent Swarm 实现异构子任务的并发执行,在降低推理延迟的同时提升复杂智能体工作负载的性能。

基于视觉-文本智能和智能体群,Kimi K2.5 在基准测试和真实世界任务上展现强大性能。通过开源后训练检查点,Moonshot AI 旨在支持开源社区构建可扩展的通用智能体系统,加速向通用智能体智能迈进。