Ovis2.5——技术报告详解

引言: Ovis2.5 是阿里国际推出的新一代视觉语言模型,基于 Ovis 架构迭代开发。核心改进包括:(1)原生分辨率感知:用 NaViT 替代固定分辨率 ViT,消除破坏性分块,保留全局结构和细粒度细节;(2)深度推理能力:引入可选的「思考模式」,通过反思导向数据训练实现自纠和修订。Ovis2.5-9B 在 OpenCompass 达到 78.3 平均分,Ovis2.5-2B 达到 73.9,均取得同规模开源模型 SOTA。

✈️ 引言

多模态大语言模型(MLLM)领域快速推进,涌现出 LLaVA-Next、Qwen2.5-VL、InternVL3、GLM-4.1V 等强大开源模型。这些模型大多采用传统架构:通过简单投影器(如 MLP)连接预训练视觉 Transformer(ViT)和大语言模型(LLM)。

在先前工作 Ovis 中,作者识别出 MLP 投影器产生的视觉嵌入的连续结构与文本嵌入的离散结构之间的失配问题。Ovis 架构通过可学习视觉嵌入表实现文本和视觉嵌入的结构对齐,验证了其优于传统设计的有效性。

在此基础上,Ovis 系列迭代发布了 1.5、1.6、2.0 版本,逐步增强高分辨率图像、多图像和视频输入、OCR、多语言和数学推理等能力。然而,即使最新的 Ovis2 在需要深度推理或视觉密集内容(如复杂图表)详细分析的任务上仍有困难。

阅读提示: 本文按原文结构依次介绍模型架构、训练流程和全面评估结果。Ovis2.5 在 MathVista(83.4)、OCRBench v2(63.4/58.0)、ChartQA Pro(63.8)等基准上取得开源模型领先性能。

🏗️ 模型架构

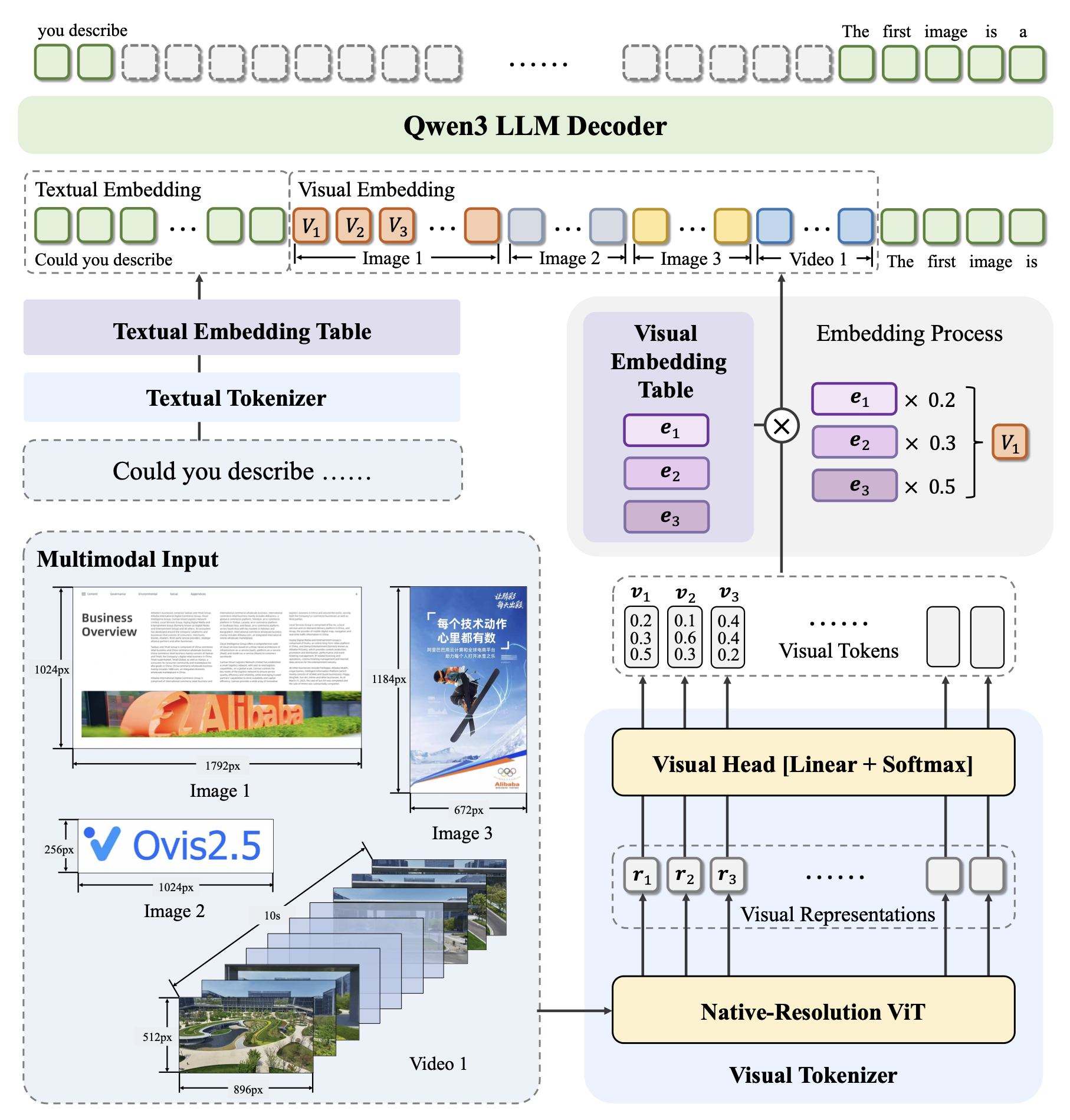

Ovis2.5 整体架构如图所示,保留 Ovis 架构的基础设计,包含三个核心模块:

视觉分词器(VT)

基于 Transformer 的组件,从图像 patch 提取特征。视觉头将每个 patch 的特征投影到离散「视觉词」词汇表上,产生该词汇表上的概率分布(即概率性视觉 token)。

视觉嵌入表(VET)

类似于 LLM 中的文本嵌入表,VET 为每个视觉词存储专用嵌入,这一设计缓解了模态间的结构失配。最终视觉嵌入通过将表中嵌入按 VT 产生的概率加权求和计算。换言之,视觉 token 的嵌入是在 VT 产生的概率分布下视觉词嵌入的期望值。

大语言模型(LLM)

预训练开源大语言模型,基于视觉和文本嵌入执行跨模态理解以生成文本输出。

架构增强

Ovis2.5 引入两项关键架构改进:

原生分辨率处理:先前版本通过将图像分割为固定大小子图像进行处理,这可能破坏全局结构和细粒度细节。Ovis2.5 用原生分辨率 ViT(NaViT)替代标准固定分辨率 ViT,实现图像以其原生分辨率直接处理。该架构在每个 ViT 块中集成旋转位置嵌入(RoPE)以增强空间感知,对复杂图表等高分辨率图像尤其有效。NaViT 从 siglip2-so400m-patch16-512 权重初始化。

升级 LLM:将 Qwen2.5 骨干替换为 Qwen3。这一升级利用 Qwen3 卓越的深度推理能力显著提升 Ovis2.5 在复杂任务上的性能和整体多模态能力。

📊 模型训练

Ovis2.5 训练流程分为两个主要阶段:预训练和后训练。预训练细分为三个阶段(P1-P3),后训练包含两个阶段(P1-P2)。

训练阶段概览

| 阶段 | VT | VET | LLM | 数据组成 |

|---|---|---|---|---|

| Pre. P1 | 训练/冻结 | 训练 | 冻结 | 图像字幕 |

| Pre. P2 | 训练 | 训练 | 训练 | OCR、图像字幕、定位 |

| Pre. P3 | 训练 | 训练 | 训练 | 多模态指令数据集 |

| Post. P1 | 训练 | 训练 | 训练 | 多模态偏好数据集 |

| Post. P2 | 冻结 | 冻结 | 训练 | 多模态 RLVR 数据集 |

预训练阶段

数据组成:训练数据来源于 COYO、Laion、Wukong、DataComp、SAM 等公开数据集和内部数据。

OCR 数据:结合公开数据集和内部收集的文档、图表、海报、截图。使用 MLLM 集合生成标注并合成问答对,后续按图像分辨率、语言和场景多样性过滤。

定位数据:来自两类来源——带现有边界框标注的公开数据集(如 RefCOCO),以及自动流水线(检测模型识别定位实体后 MLLM 生成问答对)。

推理数据:收集现有开源 CoT 数据集,用 MLLM 为训练集中仅含直接答案的 QA 对合成推理路径。还生成带

<think>...</think>标签的「思考风格」数据,教授模型反思和自纠等高级认知过程。

训练策略:

P1:VET 预训练:主要目标是训练视觉嵌入表。使用非对话格式的图像-字幕对数据集。ViT 从 siglip2-so400m-patch16-512 初始化并冻结大部分参数,仅训练最终 ViT 层、视觉头和 VET。输入图像调整至 4482 到 8962 像素间并保持原始宽高比。由于预训练 ViT 缺少 RoPE,采用动态位置嵌入插值处理变化分辨率,RoPE 本身保持禁用以确保稳定性。

P2:多模态预训练:过渡到所有模块全参数训练,建立核心视觉理解并与对话格式对齐。训练数据扩展到 OCR、图像字幕和视觉定位任务的对话数据。支持分辨率范围显著扩展到 4482 到 17922(约 200K 到 3.2M 像素)。RoPE 在每个 ViT 块中激活,增强模型空间感知。

P3:多模态指令微调:继续全参数训练,重点增强模型遵循多样化多模态指令的能力。训练语料丰富新输入类型(纯文本、多图像、视频),扩展到通用 QA、多语言对话、OCR、图表分析、知识 QA、STEM、医疗等领域。引入带 Qwen3 兼容 <think>...</think> 标签的「思考风格」样本,教授模型执行反思和自纠。

后训练阶段

DPO 数据:覆盖纯文本、单图像、多图像、视频模态的多模态偏好数据。对于推理导向任务,使用普通 CoT 和「思考风格」格式推理并计算与真实答案的可验证分数;对于通用任务,使用基于 MLLM 的评分机制。

RLVR 数据:来自广泛领域,主要聚焦开源数学问题,还包括科学 QA 和涉及逻辑推理的视觉 QA。合成大量信息嵌入图像而非文本的数据。为提高选择题质量,将部分选择题转换为填空格式,减少不经过扎实推理正确猜测答案的可能性。

训练策略:

P1:多模态 DPO:整个 Ovis2.5 模型(包括视觉模块和 LLM)进行全参数训练。使用直接偏好优化(DPO)作为主要偏好目标,辅以负对数似然(NLL)目标稳定优化。每个查询使用预训练阶段最终检查点生成候选响应组,根据标签形成多个偏好对。

P2:多模态强化学习:使用组相对策略优化(GRPO)在 RLVR 数据集上进一步提升推理能力。仅更新 LLM 参数并冻结视觉模块,使 GRPO 在可验证、以推理为中心的任务上优化策略而不降低模型整体多模态能力。

训练基础设施

高效训练大型多模态模型面临两大挑战:(1)图像、视频、文本数据大小变化导致的计算负载不平衡;(2)先前训练框架的内存限制。通过针对性优化实现 3-4 倍端到端加速。

负载均衡的数据打包:传统训练中不同长度样本填充到统一大小导致计算浪费和 GPU 空闲。实现数据打包策略,将多个较短样本组合为单个较长序列,最小化填充,减少浪费计算,创建更均衡的 GPU 工作负载。

混合并行框架:基于 Megatron 开发混合并行框架,结合数据并行(DP)、张量并行(TP)和上下文并行(CP),有效减少大规模模型训练的内存占用。

🎯 评估结果

整体性能

使用 OpenCompass 套件评估整体性能,对 MMBench、MMStar、MMMU、MathVista、HallusionBench、AI2D、OCRBench、MMVet 八个关键基准平均:

Ovis2.5-2B 性能:

| 模型 | MMBench | MMStar | MMMU | MathVista | HallusionBench | AI2D | OCRBench | MMVet | Avg |

|---|---|---|---|---|---|---|---|---|---|

| Ovis2-2B | 76.9 | 56.7 | 45.6 | 64.1 | 50.2 | 82.7 | 87.3 | 58.3 | 65.2 |

| MiniCPM-V-4 | 79.7 | 62.8 | 51.2 | 66.9 | 50.8 | 82.9 | 89.4 | 68.0 | 69.0 |

| Ovis2.5-2B | 79.2 | 69.8 | 59.8 | 81.4 | 59.2 | 85.5 | 88.1 | 67.9 | 73.9 |

Ovis2.5-9B 性能:

| 模型 | MMBench | MMStar | MMMU | MathVista | HallusionBench | AI2D | OCRBench | MMVet | Avg |

|---|---|---|---|---|---|---|---|---|---|

| Gemini-2.5-Pro | 88.3 | 73.6 | 74.7 | 80.9 | 64.1 | 89.5 | 86.2 | 83.3 | 80.1 |

| GPT-4o | 86.0 | 70.2 | 72.9 | 71.6 | 57.0 | 86.3 | 82.2 | 76.9 | 75.4 |

| Ovis2-8B | 83.6 | 64.6 | 57.4 | 71.8 | 56.3 | 86.6 | 89.1 | 65.1 | 71.8 |

| InternVL3-8B | 82.1 | 68.7 | 62.2 | 70.5 | 49.0 | 85.1 | 88.4 | 82.8 | 73.6 |

| GLM-4.1V-9B-Thinking | 85.3 | 72.9 | 68.0 | 80.7 | 63.7 | 87.9 | 84.2 | 66.2 | 76.1 |

| Ovis2.5-9B | 84.9 | 72.4 | 71.2 | 83.4 | 65.1 | 87.7 | 87.9 | 74.0 | 78.3 |

OpenCompass SOTA:Ovis2.5-9B 平均分 78.3,Ovis2.5-2B 平均分 73.9,均在各自规模取得开源模型 SOTA。相比前代 Ovis2-8B(71.8),Ovis2.5-9B 提升 6.5 分;Ovis2.5-2B 更是相比 Ovis2-2B(65.2)提升 8.7 分。

多模态推理

在 MMMU、MMMU-Pro、MathVista、MathVerse、MathVision、LogicVista、WeMath、DynaMath 等推理基准上评估。

Ovis2.5-9B 推理性能:

| 模型 | MMMU | MMMU-Pro | MathVista | MathVerse | MathVision | LogicVista | WeMath | DynaMath |

|---|---|---|---|---|---|---|---|---|

| Gemini-2.5-Pro | 74.7 | - | 80.9 | 76.9 | 69.1 | 73.8 | 78.0 | 56.3 |

| GPT-4o | 72.9 | - | 71.6 | 49.9 | 43.8 | 64.4 | 50.6 | 48.5 |

| MiMo-VL-7B-RL-2508 | 70.6 | 45.7 | 79.7 | 71.6 | 58.5 | 64.5 | 65.6 | 48.3 |

| Ovis2.5-9B | 71.2 | 54.4 | 83.4 | 71.1 | 53.9 | 61.5 | 66.7 | 44.1 |

Ovis2.5-9B 在 MathVista 上取得 83.4 分,超越所有对比模型包括 Gemini-2.5-Pro(80.9);在 WeMath 上取得 66.7 分领先。在 MMMU 上达到 71.2 分,展示大学级跨学科学术推理能力。

OCR 与图表

在 OCRBench v2、ChartQA Pro、ChartQA、DocVQA、TextVQA 等基准上评估:

| 模型 | OCRv2-EN | OCRv2-CN | ChartQA Pro | ChartQA | DocVQA | TextVQA | Avg |

|---|---|---|---|---|---|---|---|

| GPT-4o | 46.5 | 32.2 | 56.2 | 85.8 | 90.9 | 89.6 | 66.9 |

| GLM-4.1V-9B-Thinking | 60.5 | 57.4 | 59.6 | 87.9 | 97.1 | 91.0 | 75.6 |

| Ovis2.5-9B | 63.4 | 58.0 | 63.8 | 92.9 | 96.3 | 91.2 | 77.6 |

OCR 与图表分析领先:Ovis2.5-9B 在 OCRBench v2 英文(63.4)和中文(58.0)上超越所有对比模型包括 GPT-4o;在 ChartQA Pro 上达到 63.8 分取得最高。原生分辨率处理对复杂图表分析尤其有效,保留全局布局和细粒度细节。

视觉定位

在 RefCOCO、RefCOCO+、RefCOCOg 标准指代表达数据集上评估:

| 模型 | RefCOCO avg | RefCOCO+ avg | RefCOCOg avg | Overall |

|---|---|---|---|---|

| InternVL3-8B | 91.7 | 87.5 | 89.8 | 89.6 |

| MiMo-VL-7B-RL-2508 | 91.1 | 87.5 | 88.6 | 89.1 |

| Ovis2.5-9B | 92.2 | 87.8 | 90.2 | 90.1 |

Ovis2.5-9B 取得 90.1 平均分,在对比开源模型中领先。尤其在更具挑战性的 RefCOCOg 数据集上(以复杂描述著称),在验证集和测试集上均超越所有竞争对手。

多图像与视频

在 BLINK、MMT-Bench、VideoMME、MVBench、MLVU、TempCompass 等基准上评估:

| 模型 | BLINK | MMT-Bench | VideoMME (w/ sub) | VideoMME (w/o sub) | MVBench | MLVU | TempCompass |

|---|---|---|---|---|---|---|---|

| Ovis2-8B | 55.0 | 66.4 | 71.6 | 68.0 | 68.2 | 76.4 | 69.3 |

| GLM-4.1V-9B-Thinking | 65.1 | 67.6 | 73.6 | 68.2 | - | - | - |

| Ovis2.5-9B | 67.3 | 69.3 | 72.8 | 68.6 | 69.7 | 76.4 | 72.6 |

Ovis2.5-9B 在 BLINK(67.3)和 MMT-Bench(69.3)上超越其他模型,展示优越的跨图像推理能力。视频理解方面在 MLVU(76.4)和 TempCompass(72.6)上取得领先。

💡 结论

Ovis2.5 在 Ovis 系列基础架构之上,在视觉感知和多模态推理两方面引入重大改进。感知侧,集成 NaViT 以原生分辨率处理图像,保留图表等视觉密集内容所需的细粒度细节和全局结构。推理侧,引入先进的「思考模式」范式,通过反思导向数据训练实现复杂任务的自纠和修订,提供推理时可控制的延迟与准确率权衡。

在广泛挑战性基准评估中,Ovis2.5 在 OpenCompass 上为同参数级别建立新的 SOTA,并在 STEM、OCR 与图表、视觉定位、多图像/视频理解等多个领域取得领先结果。

局限与未来方向: 1. 4K 级高分辨率:扩展感知能力到 4K 级高分辨率图像同时保持准确率 2. 长视频处理:处理长输入视频并支持更丰富的时序推理 3. 工具集成:更紧密地集成工具使用以支持行动增强推理